SEO und GEO für B2B Unternehmen - Suche und Recherche im Zeitalter von KI

Sichtbarkeit im Netz - SEO und GEo einfach erklärt. Inklusive Tech-Dive für Spezialisten

Sie möchten diesen Artikel lieber als PDF lesen?

Vielleicht möchten Sie diesen Artikel lieber als PDF herunterladen und bequem in Ruhe lesen oder ausdrucken. Oder Sie möchten den Artikel Ihren Kolleginnen und Kollegen oder Mitarbeiter*innen schicken.

Hier können Sie das gesamte Dokument kostenlos als PDF herunterladen.

Inhaltsangabe

Kapitel 1: Indexierung – Der Katalog und das leere Regal

Kapitel 2: Ladezeiten etc. – Das Bleibuch und die verschlossene CD

Kapitel 3: Struktur im SEO & GEO – Titel, Deckblatt und die Lesebrille

Kapitel 4: Human Behaviour – Die Beobachtung des menschlichen Verhaltens

Kapitel 5: Trust Signals – Der Experte und die Empfehlungsschreiben

Kapitel 6: Hreflang & Co. – Der internationale Gast am falschen Regal

Kapitel 7:GEO – Die Revolution hin zum qualifizierten Fachberater

Kapitel 1: Indexierung - Der Katalog und das leere Regal

Warum Ihre Website unsichtbar ist (Architektur & Indexierung)

Stellen Sie sich vor, Sie betreten die größte Bibliothek der Welt. Sie gehen zum Tresen und fragen den Bibliothekar nach der besten Lösung für Ihr hochkomplexes Problem. Was glauben Sie, was jetzt passiert? Rennt der Bibliothekar los, sprintet durch kilometerlange Gänge, zieht Millionen von Büchern aus den Regalen, liest sie quer und kommt nach drei Stunden schweißgebadet mit der perfekten Empfehlung zu Ihnen zurück?

Natürlich nicht. Wenn der Bibliothekar erst anfangen würde zu suchen, wenn Sie Ihre Frage stellen, würden Sie verhungern, bevor Sie eine Antwort bekommen.

Die Wahrheit ist: Der Bibliothekar arbeitet nachts. Wenn die Bibliothek geschlossen ist, geht er still und leise durch die Gänge. Er schlägt jedes einzelne Buch auf. Er liest den Titel, überfliegt die Kapitel, erfasst den Kern der Handlung und schreibt eine kleine, präzise Karteikarte. Diese Karteikarte sortiert er in seinen gigantischen Zettelkasten ein – den Katalog.

Wenn Sie am nächsten Morgen Ihre Frage stellen, geht der Bibliothekar nicht zu den Regalen. Er öffnet nur seinen Zettelkasten. Er gleicht Ihre Frage in Millisekunden mit seinen Millionen Karteikarten ab und zieht die relevantesten heraus.

Das bringt uns zu der härtesten und wichtigsten Regel der gesamten digitalen Sichtbarkeit: Wenn der Bibliothekar nachts keine Karteikarte für Ihr Buch geschrieben hat, existiert Ihr Buch für ihn nicht. Es ist völlig egal, ob Ihr Buch den goldenen Literaturnobelpreis gewonnen hat. Es ist egal, ob Sie den teuersten Designer für das Cover bezahlt haben. Es ist egal, ob die Lösung für den Weltfrieden darin steht. Steht es nicht im Katalog, wird es niemals empfohlen.

Und warum sollte der Bibliothekar keine Karteikarte schreiben?

Vielleicht haben Sie das Buch in einen Tresor gelegt und ihm den Schlüssel nicht gegeben. Vielleicht haben Sie das Buch so tief im Keller versteckt, dass er es in seiner nächtlichen Schicht einfach nicht gefunden hat. Oder vielleicht haben Sie ihm einen Zettel an die Tür gehängt, auf dem stand: „Bitte draußen bleiben!“

Die Business-Analogie: Wenn der Relaunch im Nichts verpufft

Genau das ist das Grundprinzip von Suchmaschinen. Der Bibliothekar ist der Google-Bot (der Crawler). Der Zettelkasten ist der Google-Index. Und Ihre Website ist das Buch.

Ich sehe es als Forensiker in Analysen immer wieder: Unternehmen investieren beträchtliche Budgets in eine neue, glänzende Website. Es wird ein optisches Meisterwerk abgeliefert. Das Management feiert. Doch nach drei Monaten wundert man sich: Die Anfragen bleiben aus. Niemand findet die neuen Produktseiten.

Der Grund ist in den meisten Fällen keine böse Absicht, sondern eine fehlerhafte technische Architektur. Die Website wurde gebaut wie ein Labyrinth ohne Wegweiser. Suchmaschinen arbeiten mit gigantischen, aber begrenzten Ressourcen. Wenn eine Suchmaschine Ihre Website besucht, hat sie nicht ewig Zeit. Sie folgt Links wie roten Fäden. Wenn diese Fäden abreißen, wenn Weiterleitungen ins Leere führen oder technische Blockaden im Code verankert sind, bricht der Crawler ab. Er schreibt keine „Karteikarte“ für Ihre wichtigsten Produktseiten.

Das Ergebnis: Sie sind digital unsichtbar. Wer nicht indexiert ist, findet im Internet schlichtweg nicht statt. Design ohne Architektur ist wertloses Kapital.

Der Tech-Dive: Was unter der Haube wirklich passiert (Für Insider & Agentur-Prüfer)

Für alle, die es genau wissen wollen und die Architektur ihrer Seite auf den Prüfstand stellen möchten – hier sind die harten technischen Parameter, die über Leben und Tod im Index entscheiden:

Crawling vs. Indexierung:

Das sind zwei völlig unterschiedliche Paar Schuhe. Beim Crawling entdeckt der Bot Ihre Seite (er findet das Buch). Bei der Indexierung entscheidet er, ob der Inhalt wertvoll genug ist, um ihn in seiner Datenbank abzuspeichern (er schreibt die Karteikarte). Nur weil eine Seite gecrawlt wurde, heißt das noch lange nicht, dass sie rankt.

Die Robots.txt und das NoIndex-Tag:

Das ist der Türsteher Ihrer Website. Oft wird nach einem Relaunch schlichtweg vergessen, das „Disallow“ in der Robots.txt oder das „NoIndex“-Tag im Head-Bereich der Seite zu entfernen. Die Seite verbietet Google also buchstäblich den Zutritt. Ein kleiner, aber oft fataler Flüchtigkeitsfehler.

Die XML-Sitemap:

Das ist der Grundriss der Bibliothek, den Sie dem Bibliothekar am Eingang in die Hand drücken. Eine saubere, dynamische Sitemap zeigt der Suchmaschine sofort, wo die wichtigsten und neuesten Seiten liegen. Fehlt sie, muss der Bot im Dunkeln tappen.

Das Crawl Budget:

Google verbringt nicht unendlich viel Zeit auf Ihrer Seite. Sie haben ein Zeitkonto (Crawl Budget). Wenn Ihr Server extrem langsam antwortet oder der Bot durch tausende irrelevante Filter-URLs (z.B. /produkte?farbe=rot&groesse=m) gejagt wird, verbraucht er sein Budget, bevor er bei Ihren eigentlichen Kernseiten ankommt. Er geht nach Hause, ohne die wichtigen Dinge gesehen zu haben.

Orphan Pages (Verwaiste Seiten):

Das sind Seiten, die auf Ihrem Server existieren, auf die aber kein einziger interner Link von Ihrer eigenen Website verweist. Für den Crawler sind das Bücher, die ohne Regalbretter irgendwo auf dem Boden im dunklen Keller liegen. Er findet sie schlichtweg nicht.

Der Weiterleitungs-Tod (Clientseitige Redirects):

Ein Umzug muss gemeldet werden. Wenn sich eine URL ändert, braucht es einen serverseitigen 301-Redirect (permanente Weiterleitung). Oftmals werden aus pragmatischen Gründen stattdessen JavaScript-Weiterleitungen (Clientseitig) genutzt. Das Problem: Suchmaschinen müssen JavaScript erst aufwendig rendern. Das kostet extrem viel Zeit und Crawl Budget. Oft brechen sie vorher ab – und der mühsam aufgebaute „Link-Saft“ der alten Seite verpufft im digitalen Nirwana.

Kapitel 2: Mobile-First, Page Speed, Core Web Vitals etc. Das Blei-Buch und die verschlossene CD

Warum Ihre besten Inhalte ungelesen bleiben (Technik, PageSpeed & das PDF-Grab)

Stellen Sie sich vor, der Bibliothekar hat nachts erfolgreich die Karteikarte für Ihr Buch geschrieben. Am nächsten Tag kommt ein Besucher, schildert sein Problem, und der Bibliothekar geht zielsicher zu Ihrem Regal. Er greift nach Ihrem Buch und will es herausziehen.

Doch es gibt ein Problem: Der Einband ist aus massivem Blei. Das Buch ist so unhandlich und schwer, dass der Bibliothekar es kaum bewegen kann. Es dauert zehn Sekunden, bis er überhaupt die erste Seite aufschlagen kann.

Was macht er? Er ist ein vielbeschäftigter Mann und der Besucher wartet. Er stellt das bleierne Buch zurück und greift stattdessen zu dem leichten, handlichen Taschenbuch direkt daneben – dem Buch Ihres Wettbewerbers.

Nehmen wir aber an, der Bibliothekar bringt die Geduld auf und schlägt Ihr Buch tatsächlich auf. Er blickt auf die Seiten, aber sie sind leer. Statt eines Textes klebt ganz hinten im Einband eine CD.

Der Bibliothekar seufzt. Er könnte diese CD zwar in seinen alten Computer im Hinterzimmer einlegen und den Text mühsam auslesen, aber er weiß genau, wie die Menschen reagieren, wenn er ihnen diese CD in die Hand drückt.

Die meisten Besucher haben heute gar keinen CD-Player mehr dabei. Wenn sie versuchen, die Inhalte unterwegs zu entziffern, brauchen sie eine Lupe, müssen wild hin- und herblättern und geben meistens frustriert auf.

Der Bibliothekar beobachtet diese Frustration sehr genau – und stuft Ihr Buch für die Zukunft massiv ab.

Die Business-Analogie: Ladezeiten und der Bruch in der Customer Journey

Diese beiden Bilder stehen für die zwei größten architektonischen Barrieren in der digitalen Akquise: mangelnder PageSpeed (das Blei-Buch) und das PDF-Grab (die verschlossene CD).

Ein „bleiernes Buch“ ist eine Website, die zu langsam lädt. Ladezeit ist heute kein reines IT-Thema mehr, sondern harte Vertriebswährung. Wenn eine Seite auf dem Smartphone länger als drei Sekunden lädt, springt ein Großteil der potenziellen Kunden ab, noch bevor sie Ihr Logo überhaupt gesehen haben. Der Algorithmus der Suchmaschine simuliert exakt dieses Nutzererlebnis. Ist die digitale Infrastruktur zu schwerfällig, wird die Seite im Ranking gnadenlos nach unten gereicht – völlig unabhängig davon, wie gut das Design oder die Produkte sind.

Die „verschlossene CD“ repräsentiert das klassische PDF-Grab. Viele Unternehmen investieren enorm viel Zeit und Expertise in hervorragende Produktkataloge, technische Whitepaper oder detaillierte Datenblätter – und verstecken dieses wertvolle Wissen dann in PDF-Dateien zum Download. Aus historischen Gründen oder um Print-Materialien schnell online verfügbar zu machen, wird oft dieser Weg gewählt.

Der vertriebliche Schaden ist jedoch immens: Aus einem PDF heraus kann ein Kunde weder auf „In den Warenkorb“ klicken noch nahtlos ein Kontaktformular ausfüllen. Die digitale Kundenreise (Customer Journey) reißt an dieser Stelle komplett ab. Hinzu kommt: Moderne, KI-gestützte Suchmaschinen (Generative Engines) benötigen strukturierte Daten, um semantische Zusammenhänge zu verstehen. Ein PDF ist für sie oft nur eine unstrukturierte Textwand – schwer verdaulich und ohne messbare Verknüpfungen.

Der Tech-Dive: Was unter der Haube wirklich passiert (Für Insider & Agentur-Prüfer)

Für alle, die tief in die technische Performance eintauchen möchten, sind hier die entscheidenden Parameter, die über die Nutzbarkeit und die Sichtbarkeit Ihrer Architektur entscheiden:

Die Core Web Vitals:

Dies sind die offiziellen Metriken, mit denen Google die User Experience misst. Sie sind messbare Rankingfaktoren. Dazu gehören der LCP (Largest Contentful Paint – wann ist das größte sichtbare Element geladen?), der CLS (Cumulative Layout Shift – springen Layout-Elemente beim Laden hin und her?) und die INP (Interaction to Next Paint – wie schnell reagiert die Seite auf den ersten Klick des Nutzers?).

Mobile-First-Indexing:

Suchmaschinen bewerten Ihre Website heute fast ausschließlich danach, wie sie auf einem mobilen Endgerät funktioniert. Selbst wenn Ihre Desktop-Version im Firmen-Netzwerk pfeilschnell lädt – bricht die mobile Version im 4G-Netz unter zu großen Datenmengen zusammen, gilt die gesamte Seite als „langsam“.

DOM-Size und unkomprimierte Medien (Das Blei im Buch):

Der Hauptgrund für langsame Seiten sind meist überdimensionierte, unkomprimierte Bilder oder veraltete Dateiformate. Moderne Formate wie WebP oder AVIF reduzieren die Ladezeit massiv. Zudem führt ein überladener Quellcode (ein zu großer Document Object Model / DOM-Tree mit unnötig vielen verschachtelten Elementen) zu starken Verzögerungen beim Rendern der Seite im Browser.

Semantisches HTML vs. PDFs:

Ein Text auf einer HTML-Seite ist durch Tags (wie <h1> für Hauptüberschriften oder <p> für Absätze) logisch und maschinenlesbar gegliedert. Die KI versteht die inhaltliche Gewichtung. In einem PDF fehlen diese maschinenlesbaren Signale meistens. Zudem sind PDFs nicht „responsive“, passen sich also nicht der Bildschirmgröße eines Smartphones an. Die Folge ist das nutzerunfreundliche „Pinch-to-Zoom“ (hineinzoomen und seitlich wischen), das fast immer zum Abbruch führt.

Der Analytics-Blindflug:

Auf einer sauberen HTML-Struktur lässt sich messen, wie weit ein Nutzer liest, wo er scrollt und an welcher Stelle er das Interesse verliert. Bei einem PDF-Download sehen Sie lediglich den initialen Klick auf den Download-Button. Ob das Dokument danach 20 Minuten lang studiert oder nach zwei Sekunden ungelesen gelöscht wird, bleibt für die Web-Analyse ein schwarzes Loch.

Kapitel 3: Struktur im SEO - Title-Tags, H-Struktur, Meta-Descriptions und die Lesebrille

Warum Struktur über Sichtbarkeit entscheidet (OnPage & Content-Architektur)

Nehmen wir an, Sie haben die ersten beiden Hürden gemeistert: Der Bibliothekar hat Ihr Buch in seinen Zettelkasten aufgenommen (Indexierung) und es lässt sich mühelos und schnell aufschlagen (PageSpeed). Nun steht er vor der nächsten, entscheidenden Aufgabe: Er muss in Sekundenschnelle verstehen, ob dieses Buch die perfekte Antwort auf die Frage seines Besuchers liefert.

Wie geht er vor? Er liest nicht sofort den kompletten Text. Er schaut zuerst auf das Cover und liest den Titel. Dann dreht er das Buch um und überfliegt den Klappentext, um eine kurze Zusammenfassung zu erhalten. Schließlich schlägt er das Inhaltsverzeichnis auf und scannt die Kapitelüberschriften.

Wenn der Titel auf dem Cover „Chirurgische Instrumente“ lautet, das Inhaltsverzeichnis aber plötzlich von „Gartenbau“ handelt, ist der Bibliothekar verwirrt und legt das Buch zurück. Stimmt jedoch alles überein, wirft er einen Blick auf das Layout der Seiten. Er prüft, ob der Text klar strukturiert ist, ob es Absätze gibt und ob man das Buch zur Not auch ohne Lesebrille lesen kann. Er achtet dabei penibel darauf, ob die innere Logik des Werkes hält, was das Cover verspricht. Wenn das erste große Hauptkapitel vielversprechend beginnt, sich danach aber in hunderten, unzusammenhängenden Unterpunkten ohne roten Faden verliert, schrillt bei ihm die Alarmglocke.

Er sucht nach klaren Orientierungspunkten, die dem Auge Halt geben – wie Fettungen, Aufzählungszeichen oder sinnvoll gewichtete Zwischenüberschriften. Fehlt diese Hierarchie völlig und die Informationen fließen wahllos ineinander über, muss der Bibliothekar selbst mühsam raten, wo ein Gedanke endet und der nächste beginnt. Er weiß aus jahrelanger Erfahrung: Ein Besucher, der erst eine inhaltliche Entschlüsselungsarbeit leisten muss, bevor er das eigentliche Problem lösen kann, wird das Buch entnervt beiseitelegen.

Deshalb sortiert der Bibliothekar Werke rigoros aus, die zwar fachlich vielleicht korrekt sein mögen, deren inhaltliche Architektur jedoch einem unaufgeräumten Dachboden gleicht. Ist das Buch hingegen nur ein einziger, gigantischer Textblock ohne Punkt und Komma, weiß er sofort: „Das tue ich meinem Besucher nicht an.“

Die Business-Analogie: Wenn Maschinen raten müssen, verlieren Sie

Dieses Vorgehen des Bibliothekars ist die exakte Blaupause dafür, wie Suchmaschinen den Inhalt einer Website bewerten (OnPage-SEO). Eine Website kann optisch noch so beeindruckend gestaltet sein – wenn die unsichtbare, semantische Struktur dahinter fehlt, verliert sie ihre Sichtbarkeit.

Oftmals entstehen Websites aus einer rein visuellen Perspektive. Es wird darauf geachtet, dass Überschriften in der passenden Unternehmensschriftart und -größe dargestellt werden. Für den menschlichen Betrachter sieht das hervorragend aus.

Doch der Algorithmus einer Suchmaschine „sieht“ kein Design. Er liest reinen Text und Code. Er muss sich an hierarchischen Markierungen orientieren, um das Hauptthema (das Cover) von den Unterthemen (den Kapiteln) zu unterscheiden.

Fehlt diese klare Struktur, zwingen Sie die Suchmaschine zum Raten. Und Suchmaschinen hassen es zu raten. Wenn nicht in den ersten Millisekunden glasklar maschinenlesbar ist, welches konkrete Problem Ihre Seite löst, wird der Wettbewerber bevorzugt, der seine Inhalte besser strukturiert hat.

Hinzu kommt das Thema der digitalen Barrierefreiheit (Accessibility): Eine Suchmaschine ist im Grunde blind für Bilder. Wenn Sie der Maschine nicht über versteckte Texte erklären, was auf einem Bild zu sehen ist, verpufft dessen Informationswert vollständig.

Der Tech-Dive: Was unter der Haube wirklich passiert (Für Insider & Agentur-Prüfer)

Für alle, die die inhaltliche Architektur ihrer Website auf den forensischen Prüfstand stellen wollen – hier sind die Parameter, die den Unterschied zwischen „hübsch anzusehen“ und „maschinenlesbar“ ausmachen:

Title-Tag und Meta-Description (Das Cover und der Klappentext):

Der Title-Tag ist das stärkste inhaltliche Ranking-Signal. Er ist das, was der Nutzer in den Suchergebnissen als großen blauen Link anklickt. Steht hier nur „Herzlich Willkommen auf unserer Website“ statt der konkreten Lösung (z. B. „Minimalinvasive Instrumente für die Neurochirurgie“), ist das Buch für den Bibliothekar unbeschriftet. Die Meta-Description ist der kurze Text darunter – sie rankt zwar nicht direkt, ist aber maßgeblich dafür verantwortlich, ob der Nutzer klickt oder weiterscrollt (Click-Through-Rate).

Die strikte H-Struktur (Das Inhaltsverzeichnis):

Überschriften werden im HTML-Code von <h1> bis <h6> deklariert. Es gibt eine eiserne Regel: Jede Seite hat exakt eine <h1> (das Hauptthema). Danach folgen logisch untergliedert <h2> (Hauptkapitel) und <h3> (Unterkapitel). Oft wird diese Hierarchie aus Unwissenheit durchbrochen, weil eine <h3> optisch gerade besser ins Layout passte als eine <h2>. Für den Bot ist das so, als würde Kapitel 4 plötzlich vor Kapitel 2 stehen.

Alt-Attribute für Bilder (Die Lesebrille für den Bot):

Suchmaschinen-Crawler können (noch) keine Bilder mit 100%iger Sicherheit interpretieren. Sie benötigen den sogenannten „Alternative Text“ (Alt-Attribut) im Codebild. Dieser Text beschreibt für sehbehinderte Menschen (die Screenreader nutzen) und für Suchmaschinen, was auf dem Bild zu sehen ist. Fehlt dieser Text, ist das Bild für den Bot ein leerer Kasten.

Sprechende URLs (Das Leitsystem):

Die Web-Adresse (URL) muss den Weg logisch vorgeben. Eine URL wie www.ihrunternehmen.de/produkte/kategorie-a/produkt-x ist für Mensch und Maschine nachvollziehbar. Eine URL wie www.ihrunternehmen.de/p_id=74839&cat=2 zwingt die Suchmaschine wieder zum Raten.

Strukturierte Daten / Schema.org (Der maschinenlesbare Beipackzettel):

Das ist die Königsdisziplin der OnPage-Optimierung. Mit strukturierten Daten geben Sie der Suchmaschine einen standardisierten Code-Schnipsel an die Hand, der exakt definiert: „Achtung, dies ist ein Produkt. Es heißt X, kostet Y und ist auf Lager.“ Ohne diesen Code muss der Bot den Text mühsam nach diesen Informationen durchsuchen.

Kapitel 4: Dwell Time, ClickThrough-Rate, Bounce Rate. Die Beobachtung des menschlichen Verhaltens

Warum Design eine Funktion und kein Selbstzweck ist (User Signals)

Stellen Sie sich vor, der Bibliothekar hat ein Buch gefunden, das perfekt im Katalog steht (Indexierung), federleicht ist (PageSpeed) und eine tadellose Struktur aufweist (OnPage-Architektur). Er überreicht es stolz dem Besucher. Geht der Bibliothekar jetzt zurück an seinen Schreibtisch und hakt den Fall als erledigt ab?

Nein. Jetzt beginnt der wichtigste Teil seiner Arbeit: Er tritt einen Schritt zurück und beobachtet.Er schaut genau hin: Nimmt der Besucher das Buch, liest den ersten Absatz und knallt es sofort wieder zu? Oder setzt er sich an einen Tisch, blättert interessiert von Kapitel zu Kapitel, betrachtet die Grafiken und vertieft sich eine halbe Stunde lang in die Materie? Er achtet dabei auf die feinsten Nuancen der Interaktion.

Sucht der Besucher verzweifelt nach einem Stichwortregister, weil er die gesuchte Lösung im dichten Textfluss nicht auf Anhieb findet? Bleibt sein Blick an einer unübersichtlichen Grafik hängen, woraufhin er irritiert die Stirn runzelt und die Seite kopfschüttelnd überspringt?

Besonders kritisch wird es, wenn der Besucher das Buch nach wenigen Sekunden zuschlägt und schnurstracks zum Tresen zurückkehrt, um den Bibliothekar sofort nach einer besseren Alternative zum selben Thema zu fragen. Dieses abrupte Zurückkehren ist für den Bibliothekar das ultimative Warnsignal. Er begreift: Ein glänzendes Cover und ein passender Titel nützen gar nichts, wenn der Inhalt den Leser nicht führt, ihn visuell ermüdet oder durch eine unnötig komplizierte Sprache überfordert.

Der Bibliothekar kann keine Gedanken lesen, aber er kann dieses menschliche Verhalten präzise auswerten. Wenn er sieht, dass zehn Besucher in Folge ein bestimmtes Buch nach drei Sekunden genervt zurückgeben, zieht er eine unmissverständliche Konsequenz: Dieses Buch löst das Problem in der Praxis nicht. Er wird es dem elften Besucher schlichtweg nicht mehr empfehlen – selbst wenn der Titel auf dem Cover exakt zur Suchanfrage passt.

Die Business-Analogie: Wenn Optik und Funktion nicht korrelieren

Dies ist der Moment, in dem die klassische Suchmaschinenoptimierung auf das Nutzererlebnis (User Experience / UX) trifft. Die Suchmaschine bewertet nicht nur die technische Bereitstellung von Informationen, sondern misst die tatsächliche Zufriedenheit der Nutzer.

Oftmals wird Design in Unternehmen als reine Geschmacksfrage oder als Repräsentationsfläche betrachtet. In einer leistungsorientierten digitalen Architektur ist Design jedoch kein Selbstzweck, sondern ein messbares Werkzeug zur Lenkung von Nutzerverhalten.

Eine Website kann technisch brillant programmiert sein – wenn der Besucher jedoch durch eine unklare Navigation verwirrt wird, eine Textwand ohne visuelle Auflockerung vorfindet oder keine klare Handlungsaufforderung (Call-to-Action) erkennt, verlässt er die Seite umgehend.

Die Suchmaschine registriert dieses Abbrechen der Customer Journey. Sie wertet dieses Verhalten als Beweis dafür, dass Ihre Seite keine Relevanz für das gesuchte Problem besitzt, und entzieht Ihnen die Sichtbarkeit. Gute Gestaltung bedeutet im digitalen Raum also nicht zwingend, dass eine Seite „schön“ ist, sondern dass sie friktionslos funktioniert und den Besucher im Lesefluss hält.

Der Tech-Dive: Was unter der Haube wirklich passiert (Für Insider & Agentur-Prüfer)

Für alle, die datengetrieben arbeiten und verstehen wollen, wie eine Suchmaschine das Verhalten von Menschen messen kann, obwohl sie theoretisch nur aus Code besteht – hier sind die harten Währungen der sogenannten „User Signals“:

Das Ökosystem der Daten (Wie Google zuschaut):

Viele fragen sich, woher eine Suchmaschine weiß, was auf einer Website passiert. Die Antwort liegt in der Infrastruktur: Über den hauseigenen Chrome-Browser, das mobile Betriebssystem Android und eingebundene Analysetools (wie Google Analytics) liegen der Suchmaschine Abermillionen realer Nutzungsdatenbanken vor. Das Surfverhalten ist transparent.

Pogo-Sticking (Der tödliche Klick zurück):

Dies ist das schädlichste Signal für eine Website. Ein Nutzer klickt in den Suchergebnissen auf Ihren Link, die Seite lädt, der Nutzer sieht sich kurz um – und klickt im Browser sofort auf den „Zurück“-Button, um das nächste Suchergebnis anzuklicken. Für den Algorithmus ist das der eindeutige Beweis: Ihr Ergebnis war eine Enttäuschung.

Dwell Time (Die echte Verweildauer):

Dies beschreibt die Zeitspanne zwischen dem Klick auf das Suchergebnis und der Rückkehr zur Suchmaschine (oder dem Schließen des Tabs). Je höher die Dwell Time, desto relevanter stuft die Suchmaschine Ihren Inhalt ein. Gut strukturierte Texte, eingebundene Videos oder interaktive Elemente erhöhen diese Metrik massiv.

Click-Through-Rate (CTR) in den SERPs:

Wie oft wird Ihr Link in den Suchergebnissen (Search Engine Results Pages) im Verhältnis zu den Impressionen (wie oft wurde er angezeigt) geklickt? Wenn Sie auf Platz 3 ranken, aber häufiger geklickt werden als der Konkurrent auf Platz 2 (etwa durch einen präziseren Title-Tag), lernt die Suchmaschine, dass Ihr Ergebnis attraktiver ist, und stuft Sie nach oben.

Bounce Rate vs. Engagement Rate:

Die klassische Absprungrate (Bounce Rate) verliert etwas an Bedeutung gegenüber der neuen Engagement Rate (eingeführt mit Google Analytics 4). Gemessen wird nicht mehr nur, ob jemand die Seite verlässt, sondern ob er vorher mindestens 10 Sekunden aktiv gelesen hat, konvertiert ist oder tief in die Seite hineingescrollt hat.

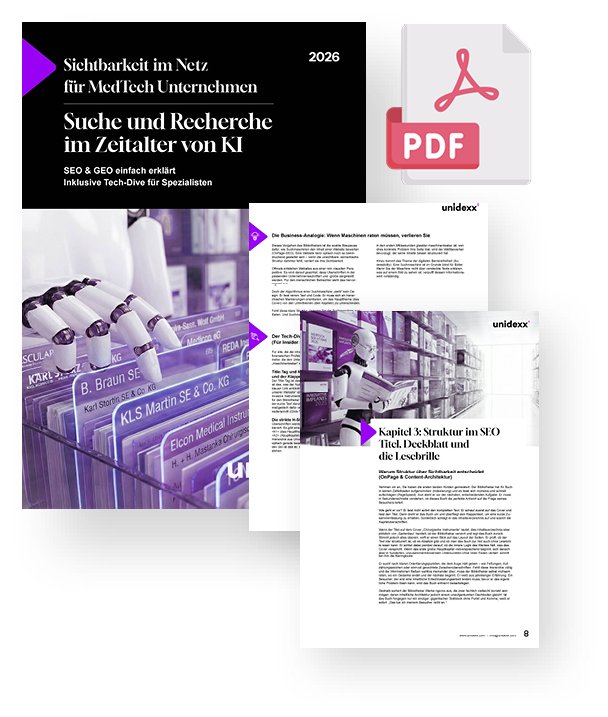

Kapitel 5: E-E-A-T, Backlink-Profil, YMYL-Filter. Trust Signals - Der Experte und die Empfehlungsschreiben

Warum Vertrauen die härteste Währung ist (OffPage-SEO & E-E-A-T)

Der Bibliothekar hat nun ein Buch in der Hand, das im Katalog steht, schnell aufzuschlagen ist, eine tadellose Struktur aufweist und von den Besuchern aufmerksam gelesen wird. Aber es geht um ein komplexes, vielleicht sogar sicherheitsrelevantes Fachthema. Woher weiß der Bibliothekar, dass der Inhalt auch fachlich korrekt ist? Dass das Buch nicht einfach von einem redegewandten Romanautor geschrieben wurde, der sich das Wissen nur oberflächlich angelesen hat?

Um das herauszufinden, blickt der Bibliothekar über das einzelne Buch hinaus. Er schaut sich in der gesamten Bibliothek um und prüft: Wie oft wird dieses Buch in den Fußnoten anderer, anerkannter Fachbücher zitiert? Gibt es renommierte Professoren oder Fachmagazine, die dieses Werk als Quelle angeben? Hat der Autor selbst einen untadeligen Ruf in der Wissenschaftsgemeinschaft? Er durchsucht das Archiv gezielt nach der Biografie des Verfassers.

Findet er dort nur einen namenlosen Autor oder vage Behauptungen ohne nachprüfbare akademische oder praktische Erfahrung, läuten bei ihm die Alarmglocken. Besonders bei hochsensiblen Themen, die tiefgreifende Auswirkungen auf die Sicherheit, die Gesundheit oder den geschäftlichen Erfolg seiner Besucher haben könnten, kennt der Bibliothekar absolut kein Pardon. Er unterzieht die Qualität der Empfehlungen einer unerbittlichen Prüfung. Stellen sich die vermeintlichen Lobeshymnen als wertlose Zitate aus unseriösen Heftchen oder dubiosen Werbebroschüren heraus, durchschaut er den plumpen Täuschungsversuch sofort und verbannt das Buch in die hinterste Reihe. Stellt er jedoch fest, dass das Werk nicht nur in anerkannten Fachjournalen zitiert wird, sondern der Autor auch echte Zertifikate, Mitgliedschaften in Fachverbänden und nachweisbare Auszeichnungen transparent im Anhang vorweist, schließt sich für ihn der Kreis.

Wenn ein Buch handwerklich perfekt ist, aber von niemandem in der Fachwelt zitiert wird, bleibt der Bibliothekar skeptisch. Wird es jedoch von den wichtigsten Standardwerken der Branche als Referenz genannt, weiß er: „Diesem Autor kann ich vertrauen. Er ist eine unbestrittene Autorität.“

Die Business-Analogie: Vertrauen ist keine Behauptung, sondern messbar

Dieses Prinzip ist der Kern der OffPage-Optimierung und der Autoritäts-Bewertung. In der digitalen Welt kann jedes Unternehmen auf seiner eigenen Website behaupten, es sei der Marktführer, der Innovations-Treiber oder biete die beste Qualität. Eine Suchmaschine kann den Wahrheitsgehalt dieser isolierten OnPage-Behauptungen nicht ohne Weiteres verifizieren. Daher sucht sie nach Bestätigungen von außen.

Ein Link von einer anderen Website zu Ihrer Präsenz (ein Backlink) ist im Grunde nichts anderes als ein digitales Empfehlungsschreiben. Doch nicht jede Empfehlung hat das gleiche Gewicht. Verweist ein unbedeutendes Hobby-Forum auf einen hochkomplexen Industrieartikel, hat das kaum Relevanz.

Wenn jedoch ein renommiertes Branchenmagazin, ein großes Partnerunternehmen, eine Universität oder ein Fachverband auf Sie verlinkt, steigt Ihre Autorität in den Augen der Suchmaschine massiv an.

Wer im digitalen Raum nachhaltig sichtbar sein will, muss verstehen: Vertrauen lässt sich nicht programmieren. Es ist das messbare Ergebnis eines starken, digitalen Netzwerks und einer echten Markt-Reputation.

Der Tech-Dive: Was unter der Haube wirklich passiert (Für Insider & Agentur-Prüfer)

Für alle, die den digitalen Ruf ihres Unternehmens datenbasiert steuern möchten – hier sind die Parameter, nach denen Suchmaschinen die Autorität einer Domain berechnen:

Das Backlink-Profil und Domain Authority:

Nicht die reine Quantität der eingehenden Links ist entscheidend, sondern deren Qualität. Die sogenannte „Domain Authority“ (oder der „Trust Score“) gibt an, wie viel Vertrauen eine verlinkende Website selbst genießt. Ein einziger Link von einer extrem vertrauenswürdigen, branchenrelevanten Domain (z.B. einer .edu- oder .gov-Adresse oder einem Leitmedium) ist wertvoller als hunderte Links aus billigen Webkatalogen.

E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness):

Dieses Konstrukt ist ein offizieller Bewertungsmaßstab der Google Quality Rater. Es steht für Erfahrung, Expertise, Autorität und Vertrauen. Unternehmen müssen durch detaillierte Autorenprofile, das Einbinden von Zertifikaten, die Nennung von Auszeichnungen und fundierte Quellenangaben beweisen, dass sie über echte Fachkompetenz verfügen.

Der YMYL-Filter (Your Money or Your Life):

Bei Themen, die tiefgreifende Auswirkungen auf die Gesundheit, die Finanzen oder die Sicherheit der Nutzer haben, greift dieser strenge Filter. Hier reicht ein gutes technisches OnPage-SEO niemals aus. Ohne ein massives, durch externe Quellen bestätigtes E-E-A-T-Fundament lässt der Algorithmus Sie für YMYL-Suchanfragen nicht auf die vorderen Plätze.

Toxische Links (Die schlechte Nachbarschaft):

So wie gute Empfehlungen nützen, können schlechte schaden. Wenn massenhaft minderwertige Spam-Seiten auf Ihre Domain verlinken, kann das Ihre Reputation vergiften. Ein regelmäßiges Überprüfen des Backlink-Profils und das strategische Entwerten (Disavow) solcher toxischen Links ist ein essenzieller Prozess, um Abstrafungen durch den Algorithmus zu vermeiden.

Brand Mentions (Co-Citations):

Moderne Algorithmen benötigen heute nicht einmal mehr zwingend einen klickbaren Link. Wenn der Name Ihres Unternehmens oder Ihrer Marke regelmäßig im direkten Textumfeld von wichtigen Fachthemen auf vertrauenswürdigen Portalen erwähnt wird (Erwähnungen ohne Verlinkung), baut die Maschine semantische Verbindungen auf und wertet dies als starkes Autoritätssignal.

Kapitel 6: Hreflang-Tag, ccTLD, GEotargeting. Der internationale Gast am falschen Regal

Warum Übersetzung keine Lokalisierung ist (Internationalisierung & Hreflang)

Stellen Sie sich vor, in unsere Bibliothek kommt ein Gast aus den USA oder dem asiatischen Raum. Der Bibliothekar erkennt sofort, woher dieser Mensch kommt. Er kennt seine Herkunft und seine kulturellen Prägungen.

Der internationale Gast sucht nach einem Fachbuch zur Lösung eines spezifischen industriellen Problems. Der Bibliothekar geht zielsicher zu Ihrem Regal und findet Ihr hervorragend strukturiertes Buch. Doch es gibt ein Problem: Das Buch ist auf Deutsch verfasst. Der Bibliothekar weiß: „Wenn ich ihm dieses Buch überreiche, legt er es nach einer Sekunde frustriert weg.“ Also belässt er es im Regal und das Geschäft kommt nicht zustande.

Nehmen wir an, Sie haben vorgesorgt und eine exakte englische Übersetzung Ihres Buches in das Regal gestellt. Der Bibliothekar reicht sie dem amerikanischen Gast. Dieser blättert interessiert, sucht aber nach Kapiteln über amerikanische Industrienormen, lokale Zertifizierungen oder spezifische Maßeinheiten. Er findet jedoch nichts davon. Stattdessen liest er seitenlang über europäische Richtlinien, die für seinen Heimatmarkt völlig irrelevant sind. Zudem ist die Tonalität des Buches extrem distanziert und technisch, während er eine nutzengetriebene, direktere Ansprache erwartet hätte. Der Bibliothekar beobachtet aufmerksam, wie der Gast bei falschen Währungsangaben oder unbekannten metrischen Maßen irritiert den Lesefluss unterbricht. Er erkennt sofort:

Eine reine Wort-für-Wort-Übersetzung ist wie ein schlecht sitzender Maßanzug – sie kaschiert zwar oberflächlich die Sprachbarriere, passt aber an keiner Stelle zur Kultur des Trägers. Wenn die Praxisbeispiele im Text die lokale Arbeitsrealität des Gastes ignorieren, wirkt das gesamte Werk auf ihn wie ein unpersönlicher, liebloser Import. Der Besucher spürt instinktiv, dass der Autor seinen spezifischen Markt, seine regulatorischen Hürden und seine Schmerzpunkte gar nicht wirklich versteht. Dieses fehlende kulturelle Einfühlungsvermögen zerstört das mühsam aufgebaute Vertrauen in Sekunden. Für den Bibliothekar ist dieser inhaltliche Bruch ein unmissverständliches Signal: Ein Buch, das nicht in der Lebensrealität des Lesers verankert ist, ist in diesem spezifischen Länder-Regal völlig deplatziert.

Der Gast bricht die Lektüre ab. Der Bibliothekar registriert dieses Verhalten exakt. Er lernt daraus: Dieses englischsprachige Buch löst die lokalen Probleme des Gastes nicht. Beim nächsten Mal wird der Bibliothekar diesem Gast lieber direkt das Buch eines amerikanischen Wettbewerbers empfehlen, das exakt für diesen lokalen Markt und dessen Anforderungen geschrieben wurde.

Die Business-Analogie: Lokalisierung schlägt Übersetzung

Diese Szene veranschaulicht die größte architektonische und inhaltliche Hürde bei der Erschließung internationaler digitaler Märkte. In vielen Unternehmen herrscht die Annahme, dass eine 1:1-Übersetzung der Website (beispielsweise ins Englische) ausreicht, um globale Sichtbarkeit zu erlangen.

Aus Sicht der Suchmaschine und des Nutzers ist das ein Trugschluss. Zum einen muss der Algorithmus technisch überhaupt erst einmal verstehen, für welches Land und welche Sprache eine bestimmte Unterseite gedacht ist. Fehlt diese technische Weichenstellung, konkurrieren Ihre eigenen Sprachversionen im schlimmsten Fall miteinander, oder die Suchmaschine liefert Nutzern in Großbritannien eine Seite aus, auf der Preise in US-Dollar statt in Pfund angegeben sind.

Zum anderen bewerten moderne Algorithmen den Kontext. Wenn ein Nutzer in den USA nach einer Lösung sucht, erwartet die Suchmaschine, dass in dem Text amerikanische Entitäten (wie lokale Normen, Behörden oder Marktspezifika) vorkommen. Fehlen diese, wird Ihnen auf diesem Markt die fachliche Autorität (E-E-A-T) abgesprochen.

Echte digitale Internationalisierung bedeutet daher nicht Übersetzung, sondern Lokalisierung – sowohl auf der Ebene des Programmiercodes als auch auf der Ebene der inhaltlichen Semantik.

Der Tech-Dive: Was unter der Haube wirklich passiert (Für Insider & Agentur-Prüfer)

Für alle, die die internationale Architektur ihrer Systeme auf ein solides Fundament stellen müssen – hier sind die technischen Parameter, die über den globalen Erfolg entscheiden:

Der Hreflang-Tag (Das maschinenlesbare Leitsystem):

Dies ist ein unsichtbarer Code-Schnipsel im Hintergrund der Website. Er sagt der Suchmaschine exakt: „Achtung, dies ist die Seite für Englisch-USA, hier ist die Variante für Englisch-UK und hier die für Spanisch-Mexiko.“ Fehlt dieser Tag, muss die Maschine raten. Ein falsch implementierter Hreflang-Tag ist einer der häufigsten Architekturfehler und führt oft zu massiven Sichtbarkeitsverlusten auf internationalen Märkten.

Domain-Strategie (ccTLD vs. Unterverzeichnisse):

Die Wahl der URL-Struktur sendet starke Signale. Eine länderspezifische Domain (ccTLD wie .de für Deutschland oder .fr für Frankreich) zeigt der Suchmaschine eine 100%ige geografische Ausrichtung. Globale Unternehmen setzen oft auf starke generische Domains (.com) mit sauberen Unterverzeichnissen (.com/de/ oder .com/en-us/). Problematisch wird es, wenn Sprachversionen wild über Subdomains und externe Plattformen verstreut werden, da hierbei die gebündelte Autorität der Hauptdomain zersplittert.

Semantische Lokalisierung (Lokale Entitäten):

Wie in der Metapher beschrieben, reicht es nicht, Worte zu übersetzen. Ein Text, der per Software (wie DeepL oder Übersetzungs-Plugins) stur ins Englische übertragen wird, übernimmt die europäischen Argumentationsketten. Für eine hohe Relevanzbewertung im Ausland müssen Texte mit den Entitäten des jeweiligen Zielmarktes angereichert werden. Dies erfordert eine redaktionelle Anpassung an lokale Suchgewohnheiten und rechtliche Rahmenbedingungen.

Geotargeting und Serverstandorte:

Auch wenn Cloud-Infrastrukturen (CDNs) heute weltweit schnelle Ladezeiten ermöglichen, spielen geografische Signale eine Rolle. Werden im Google Search Console-Konto (oder vergleichbaren Webmaster-Tools) keine klaren geografischen Ausrichtungen vorgenommen, verliert die Website einen wichtigen Vertrauensvorschuss im Zielmarkt.

Lokalisierung jenseits des Textes:

Suchmaschinen werten auch Strukturdaten aus. Wenn eine US-Seite zwar englischen Text bietet, aber im Hintergrund strukturierte Daten (Schema.org) noch immer eine deutsche Unternehmensadresse oder europäische Währungsformate als Standard ausweisen, entstehen für den Bot logische Brüche, die die Seite abwerten.

Kapitel 7: GEO, Entitäten, NLP, KNowledge Graph. Die Evolution hin zum qualifizierten Fachberater

Warum Antworten heute wertvoller sind als Links (Generative Engines & GEO)

Stellen Sie sich vor, unser Bibliothekar war in den letzten Jahren auf einem beispiellosen Fortbildungs-Marathon. Früher war er ein meisterhafter Archivar. Er hat Begriffe auf seinen Karteikarten gezählt und blitzschnell das Buch gefunden, in dem ein gesuchtes Wort am häufigsten (und in der richtigen Überschrift) vorkam.

Doch nach seinem großen, systemischen Update hat er sich radikal gewandelt: Er hat die Bücher nicht nur katalogisiert, er hat sie verstanden.

Wenn heute ein Besucher mit einem komplexen Problem an den Tresen tritt, geht der Bibliothekar nicht mehr stumm zum Regal, zieht zehn verschiedene Bücher heraus und legt sie dem Besucher auf den Tisch (die klassischen zehn blauen Links auf einer Suchergebnisseite). Stattdessen hört er zu, verknüpft sein Wissen und gibt dem Besucher sofort eine fundierte, präzise Antwort – zusammengefasst aus der Expertise der drei besten Bücher seiner Bibliothek.

Er durchschaut nun mühelos leere Worthülsen und marktschreierische Werbeversprechen. Wenn ein Buch auf hundert Seiten nur gebetsmühlenartig behauptet, der „innovativste Partner“ zu sein, ohne auch nur eine einzige komplexe Wirkungsweise oder einen technischen Zusammenhang zu erklären, legt er es verächtlich beiseite. Stattdessen sucht er gezielt nach Werken, die tiefe, logische Querverbindungen ziehen und einen echten inhaltlichen Mehrwert bieten.

Er gleicht die Thesen eines Buches in Sekundenschnelle mit dem gesamten Fachwissen in seinem Kopf ab und prüft, ob der Autor wirklich das große Ganze versteht. Nur die Bücher, die ihm handfeste Fakten liefern, um die Frage des Besuchers direkt am Tresen in eigenen Worten schlüssig zu beantworten, werden von ihm noch als Referenz genannt. Ein Buch, das keine dichte, greifbare Expertise liefert, wird in dieser neuen Ära der Beratung schlichtweg nicht mehr als Quelle zitiert.

Er nennt natürlich noch brav die Namen der Autoren, aber der Besucher muss die Bücher nicht mehr zwingend selbst lesen.

Die Business-Analogie: Entitäten sind die neue Währung

Diese Evolution beschreibt exakt den Übergang von der klassischen Suchmaschine (Search Engine) hin zu KI-gestützten Antwort-Maschinen (Generative Engines wie ChatGPT Search, Perplexity oder Google AI Overviews). Die Ära der reinen lexikalischen Keyword-Optimierung ist vorbei.

Nutzer – vor allem im B2B-Umfeld – wollen sich nicht mehr durch fünf verschiedene Unternehmens-Websites und unstrukturierte Menüs klicken, um sich eine spezifische Fachinformation mühsam zusammenzusuchen. Sie stellen einer KI eine direkte Frage und erwarten in Sekundenschnelle eine präzise Lösung.

Für Unternehmen bedeutet das einen gewaltigen Paradigmenwechsel. Eine Website, die überwiegend aus werblichen Floskeln („Wir sind Ihr innovativer Partner“) und großformatigen Bildern besteht, bietet der generativen KI schlichtweg keine inhaltliche Nahrung.

Die Maschine liest solche Seiten und erkennt: Hier ist kein echtes Wissen, hier ist nur Schaufenster-Dekoration. Die KI zitiert in ihren generierten Antworten ausschließlich die Quellen, die eine extrem hohe Informationsdichte aufweisen, Probleme konkret lösen und logische Argumentationsketten aufbauen.

Wer in Zukunft als digitaler Marktführer wahrgenommen werden will, muss unbestrittene Themenführerschaft beweisen. Es reicht nicht mehr, zu den richtigen Suchbegriffen gefunden zu werden; man muss die beste Antwort auf die drängendsten Fragen der Zielgruppe liefern.

Der Tech-Dive: Was unter der Haube wirklich passiert (Für Insider & Agentur-Prüfer)

Für alle, die ihr Unternehmen zukunftssicher (AI-ready) aufstellen möchten – hier sind die technologischen Konzepte, nach denen Generative Engines heute das Wissen der Welt bewerten:

Entitäten statt Keywords (Things, not Strings):

Eine Suchmaschine sucht heute nicht mehr nach der reinen Zeichenkette eines Wortes. Sie versteht das Konzept (die Entität) dahinter. Sie weiß, dass Entität A unweigerlich mit Entität B und C zusammenhängt. Fehlen diese semantischen Nachbarn in Ihrem Text, stuft der Algorithmus den Inhalt als fachlich oberflächlich ein, selbst wenn das Haupt-Keyword hundertmal im Text steht.

Natural Language Processing (NLP):

Moderne Algorithmen analysieren Texte durch maschinelle Sprachverarbeitung. Sie lesen nicht nur Wörter, sie bewerten die Syntax, den Kontext und die Tonalität. Sie erkennen zielsicher den Unterschied zwischen einer echten, faktenbasierten Problemlösung und leeren Marketing-Phrasen.

Semantische Vektorenräume:

Hinter den Kulissen übersetzen Sprachmodelle (LLMs) Wörter in hochdimensionale mathematische Räume. Begriffe, die inhaltlich verwandt sind, liegen in diesem Raum dicht beieinander. Eine hochrelevante Website muss diesen gesamten „Vektorfeld-Raum“ eines Themas abdecken (holistischer Content).

Generative Engine Optimization (GEO):

Während klassisches SEO darauf abzielte, einen Link auf Platz 1 der Suchergebnisse zu positionieren, zielt GEO darauf ab, als zitierte Quelle in der generierten Antwort der KI aufzutauchen. Die Hebel hierfür sind andere: Klare Thesen, strukturierte Listen, eine extrem hohe Datendichte (Information Gain) und die direkte, unmissverständliche Beantwortung spezifischer Nutzerfragen.

Der Knowledge Graph (Der weltweite Zettelkasten der KI):

Die KI speist ihr Wissen aus gigantischen, strukturierten Datenbanken, in denen Fakten miteinander verknüpft sind. Unternehmen müssen durch saubere OnPage-Architektur (siehe Kapitel 3) und starkes E-E-A-T (siehe Kapitel 5) dafür sorgen, dass sie als offizielle, vertrauenswürdige Entität (Marke) in diesen globalen Knowledge Graph aufgenommen werden

Termin beim Experten vereinbaren

Ihr Experte für E-Commerce in der Medizintechnik

Lars Kroehn

Tel.: +49 (0)7461 9145 79-0

Ausbildung

- Aufgewachsen in Tuttlingen

- Abitur am Otto-Hahn-Gymnasium

- Offizierschule der Luftwaffe (Offizier d. R.)

- Studium Kommunikationswirtschaft (BAW – Bayerische Akademie der Werbung)

- Studium Betriebswirtschaftslehre (AKAD University)

Expertise

- Marktforschung und Beratung Vocatus AG (Part of Accenture)

- 12 Jahre selbstständ. Berater für Marktforschung und Digitalisierung im Gesundheitswesen

- Kunden u. a. Asklepios GmbH & Co. KGaA, Sana Kliniken AG, Universitätsklinik Erlangen, Klinikum Ingolstadt, Medical Park Kliniken SE, Sozialstiftung Bamberg, viele weitere

- Zuletzt vier Jahre Strategy Consultant bei TechDivison GmbH (Eine der führenden Agenturen für E-Commerce im Raum D-A-CH)

Direkt Beratungstermin vereinbaren

Vereinbaren Sie direkt einen unverbindlichen Beratungstermin

Wie geht es weiter?

In den kommenden drei Wochen werden wir weitere Teile dieser Reihe veröffentlichen. Hier schon einmal ein Ausblick.

Studie Digital Sales Readiness Medizintechnik 2026

Wie gut sind die Medizintechnik-Unternehmen im Jahr im digitalen Vertrieb aufgestellt? Wie gut uns konsequent werden die Potenziale genutzt? Wie häufig weisen die Seiten technische Mängel auf? Sind die Web-Präsenzen geeignet für den internationalen Vertrieb?

Dieser und vieler weiterer Fragen geht die Studie „Digital Sales Readiness Medizintechnik 2026“ nach. Dafür haben wir die Websites und -Shops von 48 Medizintechnik-Unternehmen genau untersucht.

Digitalisierungslösungen für kleine & mittlere Unternehmen

Kleine und mittelgroße Unternehmen der Medizintechnik stehen vor einer echten Herausforderung: Wie soll man den internationalen Anforderungen der Digitalisierung gerecht werden ohne das Budget eines großen Unternehmens oder international tätigen Konzerns?

Wir haben Lösungen speziell für diese Zielgruppe entwickelt, ohne dass Sie 60.000 € und mehr für einen professionellen Webshop oder 25.000 € und mehr für eine Top Website ausgeben müssen. Lassen Sie sich überraschen – es lohnt sich.

Veröffentlichungsdatum:

15.03.2026

Medizintechnik digital 2026 - Werden wir konkret

In diesem ganz praktischen Ratgeber zeigen wir Ihnen, wie Sie Ihre digitalen Vertriebskanäle schnell und mit überschaubarem, vertretbarem Aufwand auf ein neues Level heben können. Und für viele dieser Maßnahmen brauchen Sie nicht einmal eine Agentur.

Außerdem haben wir Ihnen eine praktische Checkliste erstellt. Überprüfen Sie selbst anhand einiger wichtiger Parameter, wie Ihre digitalen Vertriebskanäle derzeit aufgestellt sind und wie groß das Potenzial für Verbesserung und Optimierung ist.